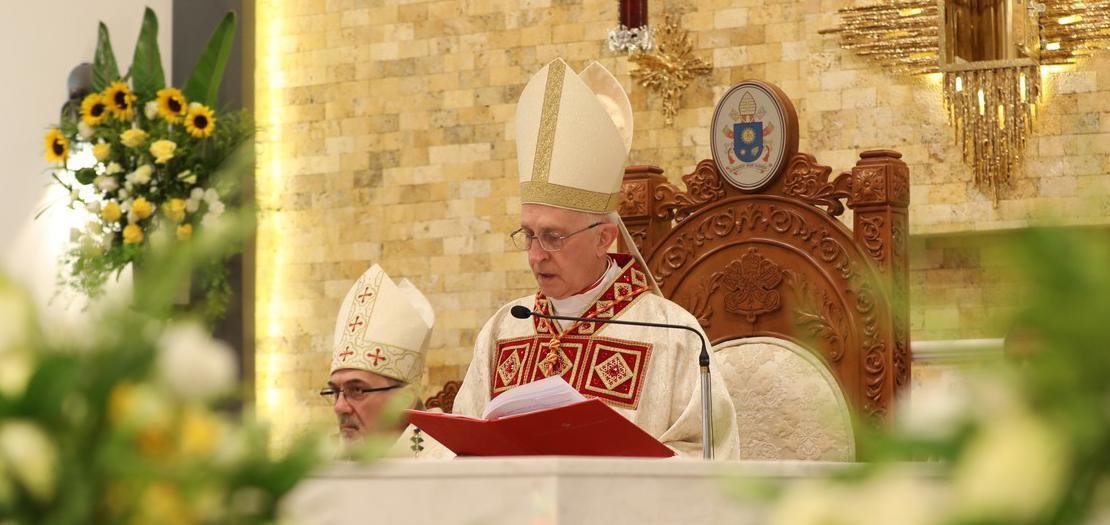

فيما يلي محاضرة للكاردينال فرناندو فيلوني، المعلم الأكبر في جماعة فرسان القبر المقدس والرئيس السابق لمجمع تبشير الشعوب، خلال مشاركته في مؤتمر حول الذكاء الاصطناعي في حقل الطب والجراحة، وتم فيه التأكيد على مركزية الإنسان وكرامته واحترامه.

الكاردينال فرناندو فيلوني :

الذكاء له جذوره في الإنسان؛ إنه متجسد. ومع ذلك، فهو لم يعد محاكاة لا تنتهك؛ منذ القرن الماضي، بدأ يتطور، من خلال التقنيات والآلات، ما نسميه اليوم الذكاء الاصطناعي الذي يكتسب بسرعة قدرات تمنح الحياة لممنتج مهم جدا؛ ضمن الاختبارات المهمة، لا يُستبعد أن يستفيد منها ايضا الذكاء الطبيعي بينما يمكن ان يتغذى بها بشكل أكبر الذكاء الاصطناعي.

لكن هذين الذكاءين لا يمكن وضعهما على مستوى واحد أبداً، لأن الأول كما قلت انه متجسد (أي يولد من جسم عضوي)، والآخر مصنوع، أي يعتمد على التكنولوجيا التي ينظمها العقل البشري، ولذلك، فإن الاثنين يختلفان بشكل كبير في طبيعتهما.

وعلى الرغم من ذلك، هل ستظل جذور “الإنسانية” هي مصدر المعرفة؟ لنأخذ مثالا مفهومًا لنا من خلال الارض التي نعيش فيها، دعونا نفكر في شجرة زيتون والتي من خلال تطعيم احد فروعها سوف تعطي الحياة لبرعم جديد. سوف يبدو بالنسبة للمشاهد جميلًا ومزدهرًا، ومليئًا بالحيوية، ولكن بالتاكيد هناك أيضًا شك فيما إذا كان المخلوق الجديد سينتج ثمارًا ذات جودة مساوية للاصل.

فالآلة لها مراحل متعاقبة وعملها مرتبط بمن يعرف آلياتها. في الحقيقة، ليس فقط الآلة، أي الذكاء الاصطناعي، هي التي تخيف، ولكن أيضًا أولئك الذين يصنعونها ثم يتلاعبون بها. لنبدأ من “الآلة” أو الآلية: الذكاء الاصطناعي، في الواقع، هو نتيجة الحسابات، والتحكم الآلي، والروبوتات، والأنظمة الرقمية، والمنطق المحوسب، ويعمل من خلال التحسين والسعي لتحقيق الكفاءة ومتابعة التحسين. من الواضح أن هذا أمر يستحق الثناء، ولكن عندما تحدث هذه العملية تلقائيًا وتضعنا أمام خيارات كاملة و”واضحة”، فهل نحن متأكدون من أن هذا هو دائمًا “الخيار الأفضل” عند 360 درجة؟

كما هو الحال في الحياة اليومية، أتقدم بالادلة والأسئلة؛ ونسأل أنفسنا: ما هو مصير ما يسمى بالذكاء الاصطناعي وما تأثيره على البشر؟ وهل يمكن أن يحل محل الذكاء البشري التقليدي الغني بالأعمال الأدبية والفنية والعلمية بمستوياتها المختلفة؟

في الواقع، الذكاء البشري ليس “حزمة” واحدة، ونحن نتساءل ما هو التأثير الذي يمكن أن يحدثه الذكاء الاصطناعي على أنواع الذكاء المختلفة (على سبيل المثال، الطبيعي والجماعي والفني). علاوة على ذلك، فإن الإنسان والمجتمع والطبيعة والكون هي أيضًا المنظور الذي يميل إليه الذكاء الاصطناعي.

ولهذا السبب نسأل أنفسنا: هل سيظل المستقبل إنسانيًا أم أنه “أوتوبيا” لا يوجد لدينا تأكيد لها على أرض الواقع حتى الآن؟ يحاول الكثيرون الإجابة على هذا السؤال وغيره: أليس هناك خطر الوقوع في التجزئة التكنولوجية والاعتماد على الخوارزميات التي تحل محل القرارات البشرية؟ فهل الديمقراطيات نفسها معرضة للخطر أم لا إذا انتهى الأمر بالديكتاتورية التكنولوجية في الأيدي الخطأ؟ فهل ما زلنا نعتقد أنه من خلال الأدوية المنتجة حديثا، سيكون الذكاء الاصطناعي قادرا على التخلص من الخلايا السرطانية؟

وفي المجال الطبي، يبدو التناقض في تطبيقه واضحا، ويبدو أن هذا المؤتمر يعكس في منهجه رغبة، مع التساؤل عن المسار الذي يجب اتباعه: التكامل بين الاحتراف الطبي والآلة أم ترك الآلة لتبرمج مسارها، فضلا عن التساؤل هل ستكون الالة هي المسؤولة؟

بين الابتكار والتقدم، ما مكانة الإنسان؟ ومن المسؤول عن حمايتها؟ غالبًا ما تنطوي حماية الإنسانية على خيارات غير واضحة، وشجاعة، وأحيانًا تتعارض مع الرياضيات والإحصاء، لأن البشر ليسوا مثاليين، فهم ضعفاء، لا حولة لهم ولا قوة.

لقد رحبت مؤخرًا بمشاركة طبيب مسيحي شاب، طبيب أمراض الرئة، الذي أخبرني عن التحديات والمعاناة في زمن الكوفيد: التعامل مع مرض جديد ومحاولة اتخاذ أفضل الخيارات لحياة المرضى. وقال إنه في بعض الأحيان، يتم اتخاذ الاختيارات بدافع الحب، للسماح بالكرامة للحظات الأخيرة من الحياة ولمساعدة المريض والأسرة على تجربة الانفصال.

هل يمكننا تفويض هذا للذكاء الاصطناعي؟

ما هي المسؤولية الأساسية التي نتحملها في هذه الحالات؟

كيف يمكن مساعدتنا في هذه المهمة دون أن نفقد المشاركة الأخلاقية والمعنوية لكوننا كشخص؟

احترافية الطبيب العالية ضمانة كبيرة، لكن هل هي كافية في حد ذاتها؟

علق البابا فرنسيس في خطابه الأخير أمام مجموعة السبعة: “إن الإنسان لا يختار فقط، ولكنه قادر في قلبه على اتخاذ القرار. القرار هو عنصر يمكننا تعريفه على أنه أكثر استراتيجية من كونه خيارًا ويتطلب تقييمًا عمليًا. في بعض الأحيان، وفي كثير من الأحيان، في مهمة الحكم الصعبة، نُدعى إلى اتخاذ قرارات لها عواقب على العديد من الأشخاص. […] سنحكم على البشرية بمستقبل ميؤوس منه إذا حرمنا الناس من القدرة على اتخاذ القرار بشأن أنفسهم وحياتهم، وحكمنا عليهم بالاعتماد على اختيارات الآلات. نحن بحاجة إلى ضمان وحماية مساحة كبيرة للسيطرة البشرية على عملية اختيار برامج الذكاء الاصطناعي: الكرامة الإنسانية نفسها على المحك”.

من خلال طرح هذه الأسئلة، فإننا لا نريد ام نقلل من اهمية التكنولوجيا، بل إلى طريقة استخدامها حتى لا يصبح أولئك الذين يسيطرون عليها حكامًا، ولا يصبح البشر عبيداً في أيدي عدد قليل من الأشخاص المطلعين الذين يتلاعبون بالعالم بما يسمى بالذكاء الاصطناعي.

والسؤال إذن هو العلاقة الصحيحة والفعالة بين الانسان والابتكار والتقدم، ومن المسؤول عن حماية هذه العلاقات؟ لأنه في حين أن الذكاء البشري هو مخترع الابتكار التكنولوجي، فإنه يبدو من المستحيل إبطاء التقدم الذي كان البشر يهدفون إليه منذ اللحظة التي اخترعوا فيها العجلة.

إن الأزمة الأخلاقية التي وقع فيها العديد من العلماء فيما يتعلق باستخدامات معينة للذرة (زيارة هيروشيما وناغازاكي هي عبارة عن تعليم ديني كبير) ليس سببها اكتشاف الذرة بحد ذاتها، ولا دراستها، لاننا نتمتع بالعديد من التطبيقات المفيدة لها في حياتنا العملية. ولكن على سبيل المثال، استعمالها كسلاح حرب تشير الى المسؤولية الكاملة عن استخدام البحث العلمي. نعود إلى دور الإنسان، ككائن أخلاقي، وخالق، وضحية علمه في نفس الوقت.

إذن ماذا ننتظر من التطبيق العلمي والعملي للذكاء الاصطناعي؟

وبالتالي، فإن حماية البشر، وكذلك حماية المجتمع والطبيعة، تتطلب بعض التفكير. في الواقع، يمكننا أن نسأل أنفسنا بطرق مختلفة فيما يتعلق بهذا السؤال نقول:

1. أولئك الذين لا يترددون، بل يسمحون لأنفسهم بالانقياد باتجاه رؤية مجردة وبمبدأ علمي وإبداعي بلا حدود، وعقل لا يأخذ في الاعتبار إلا نفسه ووهم القدرة المطلقة غير المحدودة.

2. أولئك الذين يعتقدون أن الذكاء الاصطناعي هو ببساطة للمنفعة، وليس له أهداف بل مصالح.

3. من ينوي وضع حدود لمصلحة الإنسان وكرامته ومركزيته، فالباحث، رغم استقلاليته البحثية، لا يمكن أن يكون غير مبالٍ.

يبدو لي أن عدم التردد أو وضع الحدود، أو مجرد وجود رؤية نفعية أو مناهضة للعلم، كما لو أن العلم لا يسبب سوى الضرر، هي مواقف متطرفة. ومن وجهة نظر نقدية متكاملة تنشأ الحماية الحقيقية لمصلحة الإنسان والمجتمع والطبيعة. ولذلك، لا يمكن تجاهل العلم والتكنولوجيا، حتى نصل الى الذكاء الاصطناعي، أو بالأحرى استخدامه، لا يمكن وضع المنطق جانبًا، لأنه من واجبه تحليل المشكلات، ولكن أيضًا التوصل إلى نتيجة.

وكما يقول سيلفيو سافاريزي (كبير العلماء في شركة Salesforce، وهي شركة للخدمات التقنية للشركات)، من الضروري أن يظل دور الإنسان مركزيًا، ويبدو أن الحس الأخلاقي ضروري لتحديد “الهلوسات التي تظهر أحيانًا في بعض النماذج”.

وفي مقابلة أجريت معه مؤخرًا، أكد سافاريزي كيف أن الذكاء الاصطناعي يصدر تصريحات دون معرفة ما إذا كانت صحيحة أم خاطئة، فهو لا يستطيع التمييز؛ لا يفهم ماذا يعني الكذب؛ ليس لديه حس أخلاقية. يمكنها أيضًا أن تتعلم كيف تكون ساخرة، إذا تدربت، لكنها لا تفهم ما يعنيه ذلك (انظر جريدة كورييري ديلا سيرا بتاريخ 18/3/2024).

تدرس الكنيسة أيضًا هذه الظاهرة وتحاول أن تفهم إلى أي مدى يكون من الضروري أو غير ضروري المطالبة بالالتزام الأخلاقي. يقول سافاريزي: «احذر من بناء الجسور بأعمدة لم يتم اختبارها بشكل كافٍ، والتي قد تنهار». ليس هناك شك في أن الذكاء الاصطناعي في خدمة الإنسان –سواء كمشغل أو كمستخدم– لا يبدو مقبولا فحسب، بل مرغوبا فيه؛ ينشأ التحدي منذ لحظة تصميم/استخدام الآلة لترويض الإنسان.

ولا شك أن الطب من أعظم مجالات التقدم اليوم، وهذا أمر جيد. لنفكر في فهم الصور الشعاعية، وبيانات الحمض النووي (DNA) والحمض النووي الريبي (RNA)، ودراسة الجزيئات، ورسم خرائط نقاط الاشتباك العصبي في الدماغ، والتي تفتح إمكانيات غير مسبوقة في علم الأعصاب.

ولكن ماذا عن الذكاء الاصطناعي إذا تم استخدامه للتحكم في حياة الإنسان، أو ما يسمى بنوعية حياته، أو التقييم النفعي لها، أو، على سبيل المثال، في مجال العمل، في المخاطرة التي قد تحل محلها الآلة؟ أم بعكس المواقف أن يحل الإنسان محل الآلات؟

إن التحدي لا يقتصر على التكنولوجيا المتطورة فحسب، بل يتعلق أيضًا بما يجب فعله به، أي أنه المشكلة هي أنثروبولوجية وبقوة: هل سيظل رجل الغد يتمتع بأي حرية؟ ماذا ستكون قدرته على اتخاذ القرار؟ هل ستتاح له الفرصة للحصول على سبب للأشياء وإعطاء الأسباب لها، وفي النهاية البحث عن الحقيقة؟ وهل سيكون ضميره مسؤولاً عن قراراته وعن إنتاج الفكر؟

نشر الكرسي الرسولي مؤخرًا وثيقة مهمة تتعلق بالكرامة الإنسانية بعنوان Dignitas Infinita- الكرامة اللانهائيّة؛ ونحن نسأل أنفسنا: هل ستظل هذه الكرامة موجودة أم سيكون لها مستقبل؟ هل سيكون الإنسان أم في أيدي الآلات التي يقودها عدد قليل أو مجموعات قوية؟ لأول مرة تتحدث وثيقة بابوية عن “عنف رقمي” محتمل.

وبعد التغلب على العصر الإيماني والأيديولوجي البارد، أصبح التعامل مع البحث العلمي يحفز الحوار والتفاهم؛ وهذا هو ما يميل إليه الفكر المسيحي ويوجهه، من أجل ضمان غد السلام والازدهار للبشرية من خلال الإنجازات غير العادية للعلم والتكنولوجيا وضد أي دكتاتورية لها، دون فصل تطور الذكاء المصطنع عن الفلسفة والأخلاق.

ولكن السؤال المهم ايضا هو: ما هي الأخلاق؟ وهل هناك أخلاق واحدة أو أكثر؟ وأي منها يجب أن نشير إليه فيما يتعلق بالآلات التي كنا نفكر في إعطائها منهجًا خوارزميًا، أي منهجًا أخلاقيًا؟

إن مشكلة تحديد أخلاقيات النوع البشري ليست بسيطة. لدى الإنسان العديد من السلوكيات التي تعود جذورها إلى الثقافات والمبادئ الراسخة في مختلف الأزمنة والعصور.

يكتب البابا فرنسيس، في رسالته بتاريخ 1 يناير 2024 حول الذكاء الاصطناعي، أن البحث والابتكارات التكنولوجية والعلمية “ليست مجسدة عن الواقع و”محايدة”، ولكنها تخضع للتأثيرات الثقافية. وباعتبارها أنشطة إنسانية بالكامل، فإن الاتجاهات التي تتخذها تعكس اختيارات مشروطة بالقيم الشخصية والاجتماعية والثقافية.

ومن خلال قبول هذه الرؤية، هل يمكن إعطاء الآلات “قيمًا”؟ وبالنسبة للجميع؟ وللأبد؟

وفي سياق الأنثروبولوجيا المسيحية – التي تتمثل قيمتها في الإنجيل الموجود في عقيدة الكنيسة – فقد أصبح النطاق أكثر تحديدًا بالفعل. ولكن هل ستكون الآلة التي تتحرك بشكل خطي قادرة على تعلم الفروق الدقيقة التي تتطلبها الأخلاق، على سبيل المثال الأخلاق المسيحية؟ وأخيرا، هل سيكون هناك وعي اصطناعي؟

ولذلك فإن اتباع نهج مشترك على نطاق واسع يبدو ضروريا أكثر من أي وقت مضى في مجال البحوث، ولكن أيضا في الاستخدام المقصود للتكنولوجيا.

في الختام، اسمحوا لي أن أعود إلى النقطة التي بدأت منها الحديث عن الذكاء المتجسد، وهو إحدى النعم التي اعطاها الله للبشر والتي ينبغي الاعتزاز بها، وفي الوقت نفسه، استخدامها بشكل جيد.

هذا الذكاء مدعو لعدم الاستسلام للخوارزميات بل لمواصلة التعبير عن نفسه على مستويات عديدة: من الحماية الأساسية لكرامة الإنسان وهشاشته، إلى إضفاء الطابع الإنساني على العمليات، خاصة في مراحل صنع القرار، حتى التكامل الأخلاقي والمعنوي مع التكنولوجيا من خلال الدراسات اللازمة حول استخدامها.

أتمنى لكم مؤتمراً جيداً وعملاً موفقاً في المجال المهم الذي تعملون فيه.

حماية الإنسان في الابتكار والتقدم: الحل الوسط الصحيح في عصر رقمي جديد